随着人工智能技术的快速发展,其在各个领域的应用日益广泛,但同时也带来了前所未有的安全威胁。尤其在网络与信息安全领域,人工智能既可能成为防御的利器,也可能被恶意利用,形成新型的安全挑战。

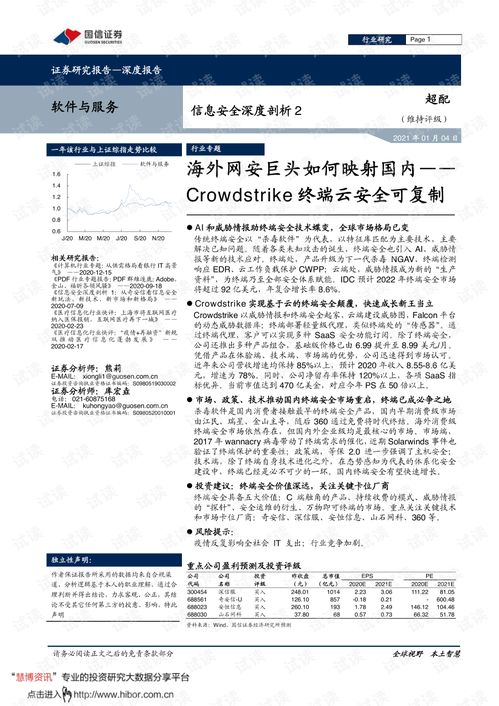

人工智能可能被用于发动更智能、更隐蔽的网络攻击。传统网络安全防御主要依赖规则和特征匹配,而人工智能驱动的攻击可以自我学习和进化,绕过这些静态防御机制。例如,攻击者可以利用生成对抗网络(GAN)制造难以识别的恶意软件变种,或通过强化学习技术自动化渗透测试,发现系统漏洞。

数据隐私面临严峻挑战。人工智能系统依赖大量数据进行训练,这些数据中可能包含敏感信息。如果数据在收集、存储或处理过程中遭到泄露,或被用于训练恶意模型,将对个人隐私和企业机密构成严重威胁。深度伪造技术的滥用更是加剧了这一风险,可能被用于制造虚假信息、进行身份欺诈等。

人工智能系统本身也存在安全漏洞。对抗性攻击可以通过轻微扰动输入数据,导致AI系统做出错误判断。在自动驾驶、医疗诊断等关键领域,这种漏洞可能造成严重后果。模型窃取、数据投毒等攻击手段也在不断演进,威胁着AI系统的完整性和可靠性。

面对这些挑战,网络与信息安全软件开发需要采取多管齐下的策略:

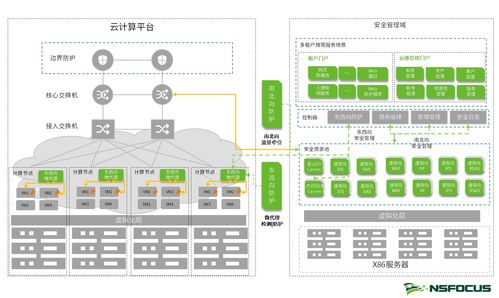

- 开发智能威胁检测系统:利用机器学习算法分析网络流量、用户行为等数据,实时识别异常模式和潜在攻击。

- 加强数据保护机制:采用差分隐私、联邦学习等技术,在保证模型性能的同时保护训练数据的隐私。

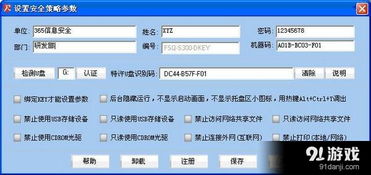

- 构建鲁棒的AI系统:通过对抗训练、输入验证等方法提高AI模型的抗干扰能力,确保其在恶意环境下的稳定性。

- 建立AI安全治理框架:制定严格的数据使用政策、模型审计流程和应急响应机制,形成全面的安全保障体系。

- 促进跨领域合作:网络安全专家、AI研究人员和政策制定者需要密切协作,共同应对新兴威胁。

人工智能既带来了新的安全威胁,也提供了创新的防御手段。只有通过持续的技术创新和全面的安全策略,我们才能在享受AI带来的便利的有效防范潜在风险,构建安全可靠的数字未来。